Unternehmen aus Bereichen wie Industrie, Forschung, Finanzen, Medizin und IT nutzen zunehmend KI-Modelle zur Datenanalyse, zur Automatisierung von Prozessen und zur Entwicklung neuer digitaler Lösungen.

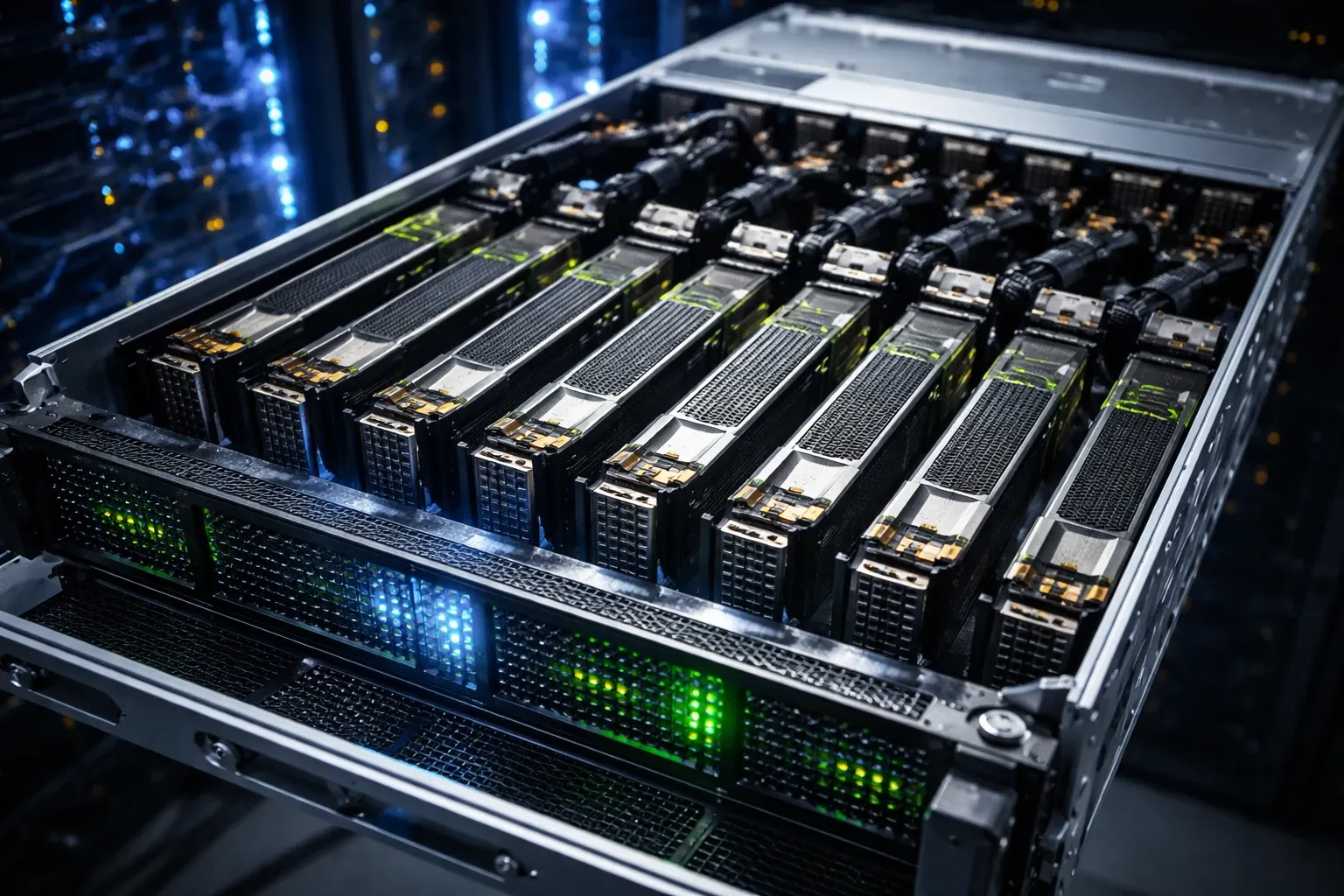

Damit solche Systeme funktionieren können, ist eine spezielle IT-Infrastruktur erforderlich. Herkömmliche Server, die für Webhosting oder Unternehmenssysteme eingesetzt werden, sind dafür in vielen Fällen nicht geeignet. Das Training und der Betrieb von Modellen der künstlichen Intelligenz erfordern deutlich höhere Rechenleistung, eine hohe Datenverarbeitungsgeschwindigkeit und spezielle Hardwarebeschleuniger.

Server für künstliche Intelligenz werden von Hardwareherstellern entwickelt, von Infrastruktur-Providern integriert und häufig in leistungsstarken Rechenzentren betrieben. Unternehmen können entweder eigene Server erwerben oder das Modell „KI-Server mieten“ nutzen.Warum Unternehmen spezielle KI-Server benötigen

Anwendungen der künstlichen Intelligenz unterscheiden sich erheblich von klassischen IT-Workloads. Während traditionelle Unternehmenssysteme hauptsächlich Transaktionen verarbeiten oder mit Datenbanken arbeiten, operieren KI-Modelle mit enormen Datenmengen und komplexen mathematischen Berechnungen.

Ein modernes Sprachmodell oder ein System zur Bildanalyse kann Milliarden von Parametern enthalten. Das Training solcher Modelle erfordert enorme Rechenressourcen und eine parallele Datenverarbeitung. Auch bei der späteren Nutzung – beispielsweise bei der Echtzeitanalyse von Daten oder beim Betrieb generativer Dienste – müssen große Informationsströme schnell verarbeitet werden.

Deshalb benötigen Unternehmen eine Infrastruktur, die speziell für solche Aufgaben optimiert ist. Server für künstliche Intelligenz unterscheiden sich von herkömmlichen Systemen vor allem durch folgende Eigenschaften:

- hohe parallele Rechenleistung

- spezialisierte Hardwarebeschleuniger

- sehr schnelle Netzwerkverbindungen

- hochleistungsfähige Datenspeichersysteme

- optimierte Kühl- und Energieversorgungssysteme

Solche Komponenten ermöglichen es, große Machine-Learning-Modelle zu trainieren, komplexe Rechenaufgaben auszuführen und Anwendungen auf Basis künstlicher Intelligenz in Echtzeit zu betreiben.

Welche Komponenten ein KI-Server enthält

Ein Server für künstliche Intelligenz ist ein hochoptimiertes System, das aus mehreren leistungsstarken Hardwarekomponenten besteht. Jede dieser Komponenten spielt eine wichtige Rolle bei der Verarbeitung großer Datenmengen und komplexer Berechnungen.

GPU-Beschleuniger

Das wichtigste Element moderner KI-Server sind Grafikprozessoren (GPUs). Ursprünglich wurden GPUs für die Verarbeitung von Grafik entwickelt, doch ihre Architektur eignet sich hervorragend für parallele Berechnungen.

Algorithmen des Machine Learning erfordern häufig die gleichzeitige Ausführung von Millionen oder sogar Milliarden mathematischer Operationen. GPUs können solche Aufgaben deutlich schneller verarbeiten als herkömmliche zentrale Prozessoren.

Deshalb werden in KI-Servern in der Regel mehrere GPUs gleichzeitig eingesetzt. Solche Systeme können über Hochgeschwindigkeitsverbindungen miteinander kommunizieren und gemeinsam große Trainingsaufgaben für Modelle ausführen.

Hochleistungsprozessoren

Neben GPUs spielen auch zentrale Serverprozessoren (CPUs) eine wichtige Rolle. Sie koordinieren die Arbeit des Systems, verwalten den Arbeitsspeicher und steuern die Datenströme innerhalb des Servers.

Moderne KI-Server verwenden häufig leistungsstarke Mehrkernprozessoren, die speziell für den Einsatz in Rechenzentren entwickelt wurden. Diese CPUs übernehmen unter anderem folgende Aufgaben:

- Vorverarbeitung von Daten

- Verwaltung von GPU-Clustern

- Kontrolle von Speicher- und Netzwerkverkehr

Durch die Kombination von CPU und GPU entsteht eine Infrastruktur, die sowohl komplexe Berechnungen als auch große Datenmengen effizient verarbeiten kann.

Schnelle Netzwerke und Speichersysteme

Ein weiterer wichtiger Faktor für Server der künstlichen Intelligenz ist die Geschwindigkeit der Datenübertragung. Beim Training von KI-Modellen werden häufig mehrere Server gleichzeitig eingesetzt, die große Informationsmengen miteinander austauschen müssen.

Deshalb kommen in KI-Infrastrukturen Hochgeschwindigkeitsnetzwerke zum Einsatz, beispielsweise 100- oder 400-Gigabit-Ethernet oder spezialisierte Hochleistungsnetzwerke.

Auch das Speichersystem spielt eine große Rolle. In KI-Servern werden häufig verwendet:

- NVMe-Speicher für schnellen Datenzugriff

- Arbeitsspeicher mit sehr hoher Kapazität

- verteilte Speichersysteme für Trainingsdatensätze

Eine solche Architektur ermöglicht eine effiziente Arbeit mit großen Datenmengen und beschleunigt den Trainingsprozess von Modellen.

Wer KI-Server entwickelt und produziert

Die Entwicklung von Servern für künstliche Intelligenz ist ein komplexer technologischer Prozess, an dem mehrere Arten von Unternehmen beteiligt sind. Solche Systeme entstehen in der Regel durch die Zusammenarbeit von Hardwareherstellern, Serverintegratoren und Infrastruktur-Providern. Jede dieser Kategorien übernimmt eine eigene Rolle beim Aufbau von Infrastrukturen für Anwendungen der künstlichen Intelligenz.

Hersteller von Serverhardware

Eine der wichtigsten Gruppen sind Hersteller von Servern. Sie entwickeln die Hardwareplattformen, auf denen Systeme für Anwendungen der künstlichen Intelligenz aufgebaut werden.

Diese Unternehmen entwickeln Servergehäuse, Mainboards sowie Stromversorgungs- und Kühlsysteme und integrieren darin moderne Prozessoren und GPU-Beschleuniger.

Zu den bekanntesten Herstellern von Serverhardware gehören:

- Dell Technologies

- Hewlett Packard Enterprise (HPE)

- Lenovo

- Supermicro

Diese Unternehmen produzieren spezialisierte Serverplattformen, die für den Einsatz vieler GPUs und für hohe Rechenlasten ausgelegt sind. Viele Modelle werden speziell für Machine Learning und Datenanalyse entwickelt.

Hersteller von Rechenbeschleunigern

Eine zweite wichtige Kategorie bilden Hersteller von Rechenbeschleunigern, vor allem von GPUs. Sie liefern die zentrale Rechenleistung moderner Systeme für künstliche Intelligenz.

Zu den führenden Unternehmen in diesem Bereich gehören:

- NVIDIA

- AMD

- Intel

GPUs dieser Hersteller werden in den meisten modernen KI-Servern eingesetzt. Sie unterstützen spezialisierte Bibliotheken und Softwaretools, die beim Training und Betrieb neuronaler Netze verwendet werden. Viele Machine-Learning-Plattformen sind beispielsweise speziell für GPU-Architekturen optimiert, wodurch sich die Datenverarbeitung deutlich beschleunigen lässt.

Cloud- und Infrastruktur-Provider

Die dritte Gruppe bilden Cloud- und Infrastruktur-Provider, die Server für künstliche Intelligenz in ihren Rechenzentren bereitstellen und betreiben.

Solche Unternehmen stellen Rechenressourcen über das Internet zur Verfügung. Dadurch können Organisationen leistungsstarke Systeme für das Training von Modellen oder für Datenanalysen nutzen, ohne eine eigene Infrastruktur aufbauen zu müssen.

Zu den größten Anbietern solcher Dienste gehören:

- Amazon Web Services

- Microsoft Azure

- Google Cloud

Neben globalen Cloud-Plattformen entwickeln auch viele Service-Provider und Betreiber von Rechenzentren Infrastrukturen für AI-Workloads. Sie bieten unter anderem GPU-Server zur Miete, Colocation sowie weitere Dienstleistungen für Unternehmen, die mit künstlicher Intelligenz arbeiten.

Wo KI-Server betrieben werden

Server für künstliche Intelligenz werden in der Regel in professionellen Rechenzentren betrieben. Solche Einrichtungen bieten die notwendigen Bedingungen für den stabilen Betrieb von Hochleistungshardware.

Moderne Systeme für AI-Berechnungen verbrauchen große Mengen an Energie und erzeugen erhebliche Wärme. Daher ist für ihren Betrieb eine leistungsfähige technische Infrastruktur erforderlich.

Wichtige Merkmale von Rechenzentren, in denen AI-Server betrieben werden, sind:

- redundante Stromversorgung

- leistungsstarke Kühlsysteme

- Hochgeschwindigkeitsnetzwerke

- physische und technische Sicherheit

In vielen Fällen werden AI-Server zu Rechenclustern zusammengefasst, die aus Dutzenden oder sogar Hunderten von Systemen bestehen. Solche Cluster ermöglichen es, Rechenaufgaben auf mehrere Server zu verteilen und das Training von KI-Modellen zu beschleunigen.

Die Unterbringung der Hardware in Rechenzentren erhöht außerdem die Zuverlässigkeit der Infrastruktur und stellt die permanente Verfügbarkeit von Rechenressourcen sicher.

Für welche Aufgaben KI-Server eingesetzt werden

Server für künstliche Intelligenz werden in zahlreichen Branchen eingesetzt. Sie dienen sowohl der Entwicklung neuer Modelle als auch dem Betrieb von AI-Diensten in produktiven Umgebungen.

Zu den häufigsten Einsatzbereichen gehören:

- Training von Machine-Learning-Modellen

- Verarbeitung von Bildern und Videos

- Analyse großer Datenmengen

- Betrieb von Spracherkennungssystemen

- Entwicklung generativer AI-Dienste

Unternehmen können AI-Server beispielsweise für die Analyse von Produktionsprozessen, die Automatisierung des Kundenservice oder die Prognose von Nachfrageentwicklungen einsetzen.

In der wissenschaftlichen Forschung werden solche Systeme zur Verarbeitung experimenteller Daten, zur Modellierung komplexer Prozesse und zur Entwicklung neuer Algorithmen genutzt.

Wie Unternehmen KI-Infrastruktur nutzen können

Es gibt mehrere Möglichkeiten, wie Unternehmen Zugang zu Infrastruktur für künstliche Intelligenz erhalten können.

Einige Organisationen bauen eigene Rechencluster auf und installieren GPU-Server in ihren Rechenzentren oder unternehmenseigenen Serverräumen.

Eine weitere Option ist die Nutzung von Cloud-Plattformen. In diesem Fall mieten Unternehmen Rechenressourcen und bezahlen sie nach Nutzung.

Darüber hinaus gibt es ein Modell, bei dem Unternehmen die Infrastruktur von Service-Providern nutzen. Solche Anbieter stellen GPU-Server zur Miete bereit, bieten Colocation für eigene Hardware oder übernehmen das Management der IT-Infrastruktur.

Die Wahl des passenden Modells hängt von den Anforderungen des Unternehmens, dem Umfang der Rechenaufgaben und den Sicherheitsanforderungen an die Daten ab.